ĐẠI HỌC QUỐC GIA TP. HỒ CHÍ MINH

TRƯỜNG ĐẠI HỌC CÔNG NGHỆ THÔNG TIN

1

CS116 – LẬP TRÌNH PYTHON CHO MÁY HỌC

TS. Nguyễn Vinh Tiệp

Thực hiện bởi Trường Đại học Công nghệ Thông tin, ĐHQG-HCM

Bài 07

LỰA CHỌN ĐẶC TRƯNG

NỘI DUNG

Thực hiện bởi Trường Đại học Công nghệ Thông tin, ĐHQG-HCM 2

1. Tại sao nên chọn đặc trưng?

2. Kỹ thuật lựa chọn đặc trưng

3. Công cụ lựa chọn đặc trưng

June 9, 2023

Thực hiện bởi Trường Đại học Công nghệ Thông tin, ĐHQG-HCM 3

June 9, 2023

Tại sao nên chọn đặc trưng?

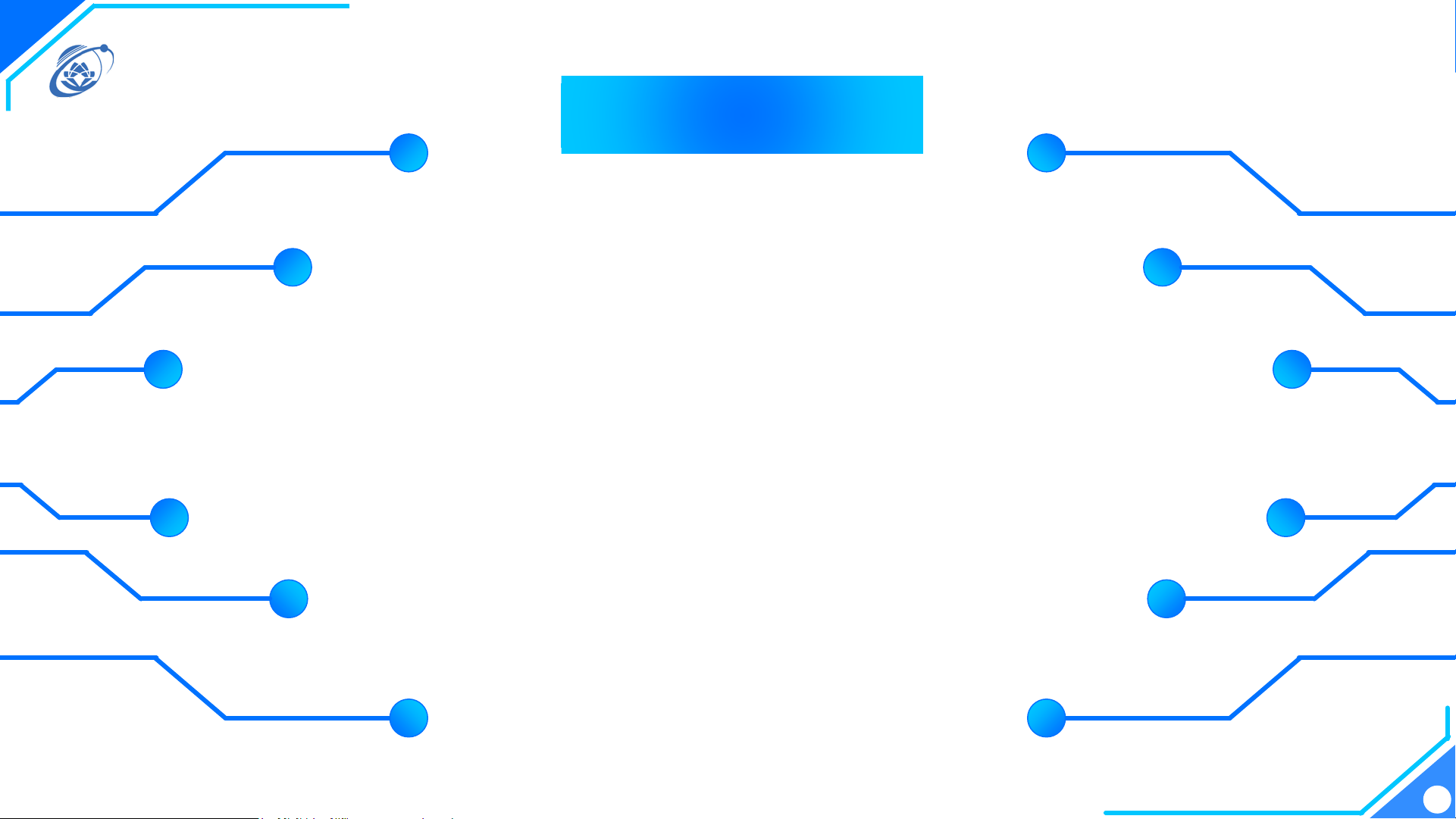

Lý do: Noise và distraction gây ra

bởi các đặc trưng không liên quan

hoặc dư thừa

Vấn đề với hiệu

suất mô hình

Tại sao lựa chọn

đặc trưng ?

Vấn đề với

overfitting

Giải pháp: Chỉ chọn các đặc trưng

phù hợp nhất →giảm noise,

distraction →cải thiện hiệu suất

của mô hình, khái quát hóa tốt hơn

Lý do: Mô hình quá phức tạp, hấp thụ

noise trong dữ liệu đào tạo hơn là mô

hình cơ bản

Giải pháp: Loại bỏ các đặc trưng

không liên quan hoặc dư thừa →độ

phức tạp của mô hình được giảm →

tránh over-fitting

Thực hiện bởi Trường Đại học Công nghệ Thông tin, ĐHQG-HCM 4

June 9, 2023

Tại sao nên chọn đặc trưng?

Lý do: Nhiều đặc trưng hơn, mô

hình phức tạp → tốn kém về mặt

tính toán và tốn thời gian

Vấn đề với thời gian đào

tạo và chi phí tính toán

Tại sao lựa chọn

đặc trưng?

Vấn đề với khả năng

diễn giải mô hình

Giải pháp: Chỉ chọn các đặc trưng

quan trọng nhất →thời gian đào tạo

có thể giảm đáng kể

Lý do: Các mô hình có quá nhiều

đặc trưng thường khó diễn giải và

giải thích hơn

Giải pháp: Chỉ sử dụng hầu hết các

đặc trưng quan trọng →dễ dàng

hơn để giải thích, giải thích hiểu việc

ra quyết định của mô hình (ví dụ: tài

chính, chăm sóc sức khỏe, lĩnh vực

pháp lý)

Thực hiện bởi Trường Đại học Công nghệ Thông tin, ĐHQG-HCM 5

June 9, 2023

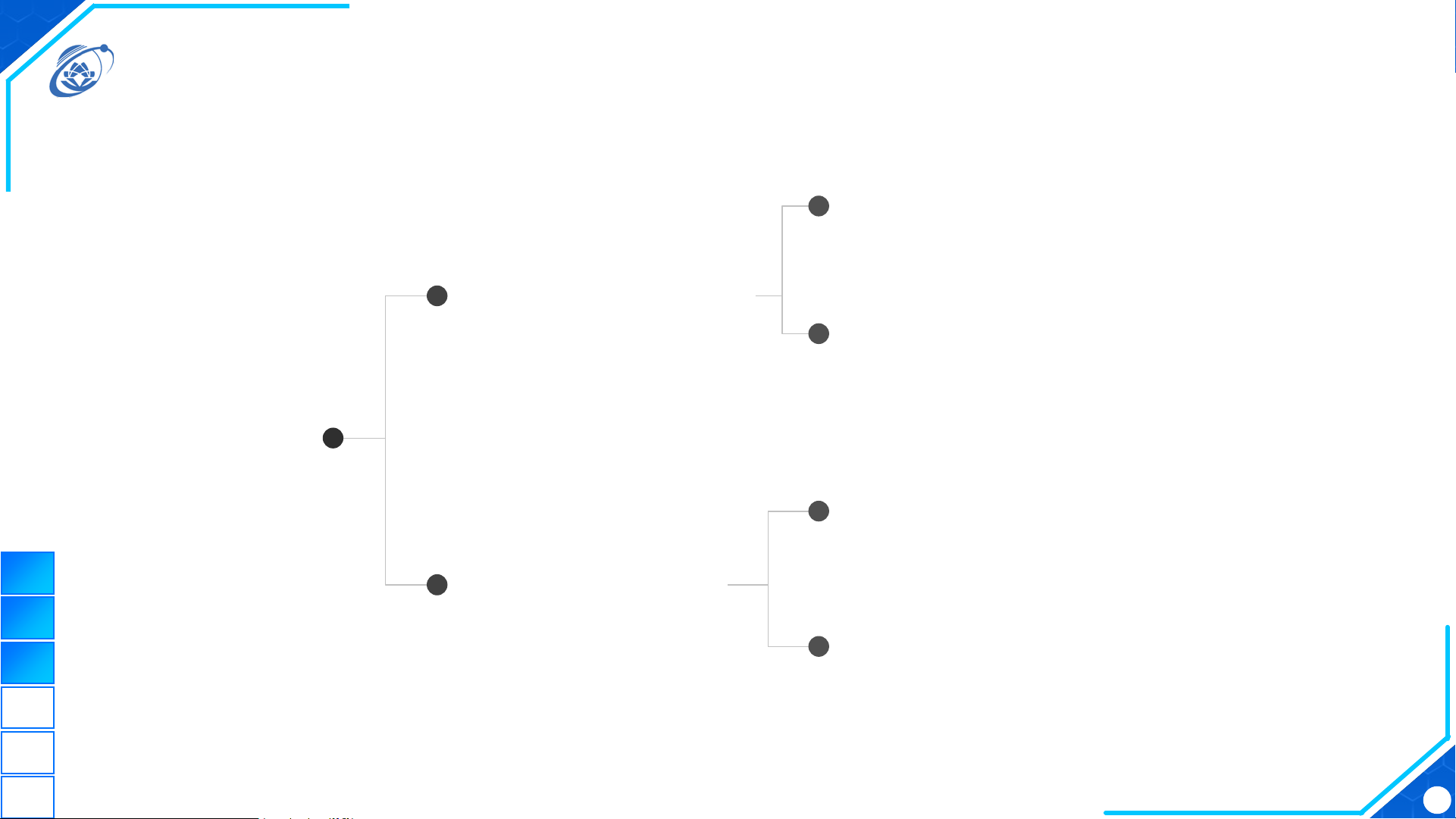

Kỹ thuật lựa chọn đặc trưng

Phương pháp Wrapper

02

●Forward Selection

●Backward Elimination

●Recursive Feature Elimination (RFE)

Phương pháp Filter

01

●Correlation coefficient: Pearson,..

●Variance Threshold

●Missing value ratio; Mutual Information

Giảm chiều

04

●Component/Factor based: Factor

Analysis, PCA, ICA

●Projection based: t-SNE, UMAP

Phương pháp Embedded

02 ●LASSO, Ridge Regression, Elastic Net

●Tree-based: Random Forest, GBM

![Đề thi kết thúc học phần Lập trình web 1 [năm] [khóa]](https://cdn.tailieu.vn/images/document/thumbnail/2026/20260226/hoatrami2026/135x160/69841772100240.jpg)