ĐẠI HỌC QUỐC GIA TP. HỒ CHÍ MINH

TRƯỜNG ĐẠI HỌC CÔNG NGHỆ THÔNG TIN

1

BÀI 02

Các biến thể của

Recurrent Neural Network

TS. Nguyễn Vinh Tiệp

Thực hiện bởi Trường Đại học Công nghệ Thông tin, ĐHQG-HCM

CS431 – CÁC KỸ THUẬT HỌC SÂU VÀ ỨNG DỤNG

2

ÔN TẬP

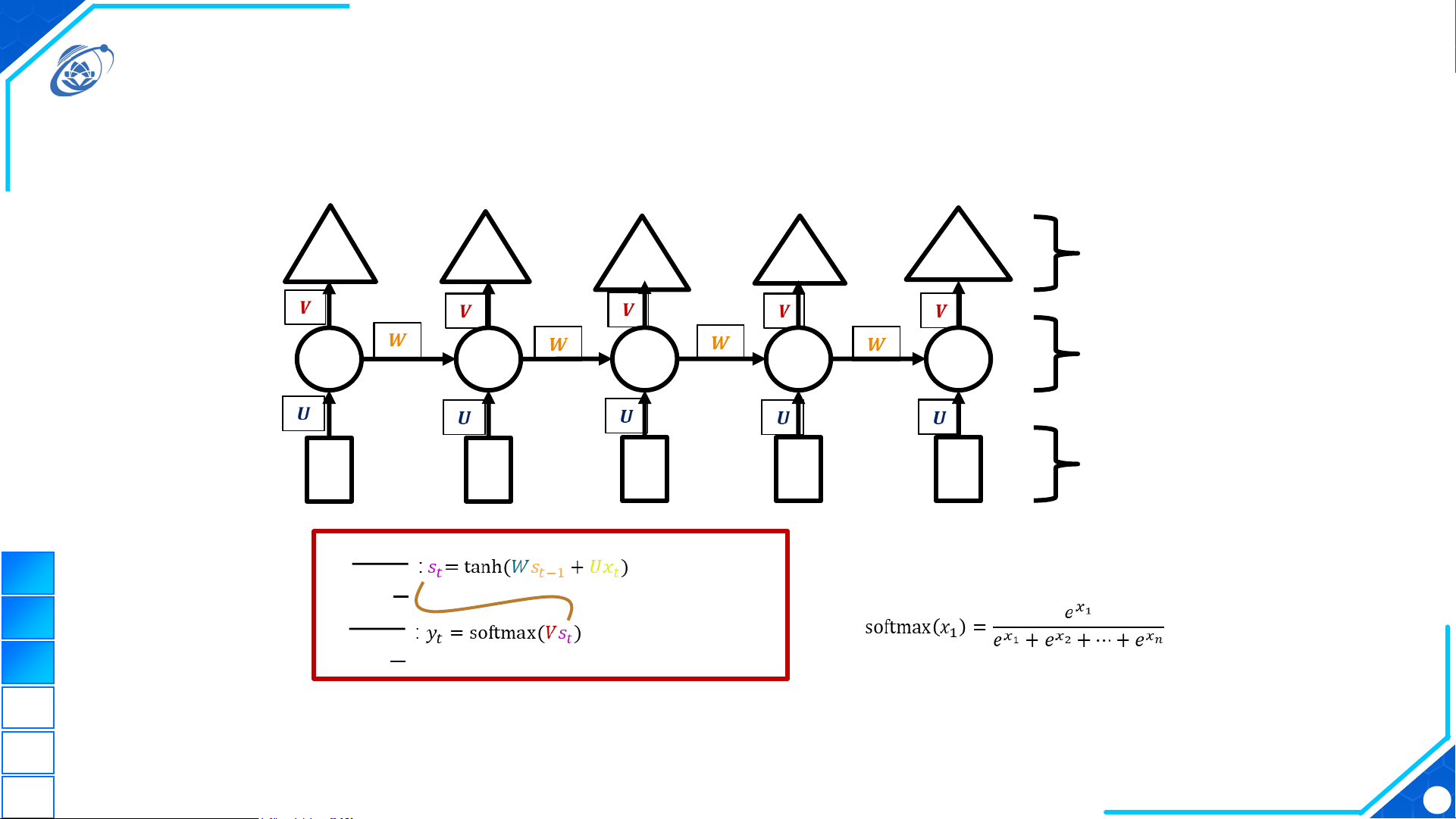

s1

x1

y1

s2

x2

y2

s3

x3

y3

s4

x4

y4

s5

x5

y5

Input xt

Hidden st

Output yt

Step

1

Step

2

3

ÔN TẬP

NỘI DUNG

4

Thực hiện bởi Trường Đại học Công nghệ Thông tin, ĐHQG-HCM

1. Long Short Term Memory

2. Gated Recurrent Unit

3. Bidirectional RNN

4. Deep-stacked RNN

5

●Long short term memory (LSTM) là một biến thể của RNN

●Với 4 thành phần chính: cell,input gate,output gate và forget gate

●Cell ghi nhớ các giá trị trong một khoảng thời gian cụ thể

●3 cổng còn lại điều hướng luồng thông tin vào / ra khỏi Cell

Giới thiệu về LSTM

![Nâng cao hiệu suất làm việc với ChatGPT: Tài liệu [Mới Nhất]](https://cdn.tailieu.vn/images/document/thumbnail/2026/20260505/baobinh_011/135x160/1131777960910.jpg)

![101 công cụ AI đang thay đổi thế giới: Tài liệu [Mới nhất]](https://cdn.tailieu.vn/images/document/thumbnail/2026/20260505/baobinh_011/135x160/8671777961920.jpg)

![Tài liệu Trí tuệ nhân tạo (AI) & Khoa học dữ liệu [mới nhất 2024]](https://cdn.tailieu.vn/images/document/thumbnail/2026/20260505/baobinh_011/135x160/571777990654.jpg)

![Công thức đặt câu lệnh với AI: Tài liệu [mô tả/định tính, ví dụ: chuẩn nhất, mới nhất]](https://cdn.tailieu.vn/images/document/thumbnail/2025/20251231/gaupanda090/135x160/1311777371375.jpg)

![Tuyển tập 188 câu lệnh dành cho ChatGPT [Mới nhất]](https://cdn.tailieu.vn/images/document/thumbnail/2025/20251231/gaupanda090/135x160/6721777371570.jpg)